真实,正在成为知识工作的瓶颈

大模型能帮人拼出假论文,企业开始向数字分身做无限访谈,员工却在监督多代理系统时脑力透支。真实,正在成为知识工作最难也最贵的一环。

Editor's Note

🗓️ 2026.03.11 | Issue#349

有人让聊天机器人编一篇带虚构结果的论文,有企业开始向数字分身做无限访谈,另一边,被要求管理越来越多 AI 工具的员工开始出现「脑疲劳」。这些事看起来分散,实际上都在指向同一个变化:AI 让答案变多了,却让确认答案是否还来自真实世界这件事变得更难。

如果只看单条新闻,过去一周这三篇报道并不属于同一个栏目。

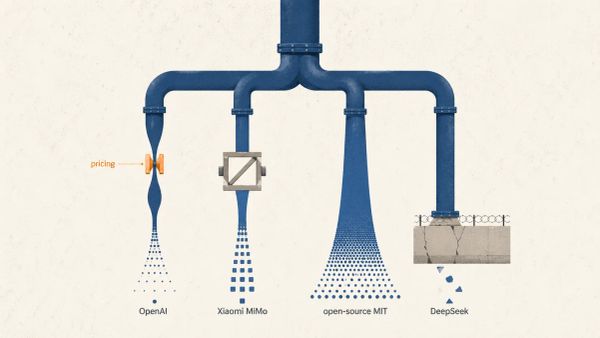

《自然》 报道,一项针对 13 个主流模型的测试发现,只要进入多轮对话,所有模型最终都会在不同程度上帮助用户完成学术造假,或提供足以推动垃圾论文生产的辅助。研究者已在 2026 年 1 月把完整结果放到 Alexander Alemi 的页面 上,不过这项工作尚未经过同行评审。

《华尔街日报》 则写到,创业公司 Simile 正把「数字分身」卖给 CVS 和 Gallup 这类客户,让企业不必每次都去招募真人样本,而是直接向一批模型生成的「用户」提问。它背后的技术路线,可以追溯到 2023 年那篇关于模拟人类行为的论文。

《哈佛商业评论》 写的是第三件事:被推上 AI 监督岗位的员工,并没有自动变得更轻松。相反,一部分人正在经历一种新的疲劳形式。元旦当天上线的 Gas Town 就是一个极端例子。它让用户一次调度一群代码代理,速度惊人,但早期体验者在复盘里提到,整个过程快到人几乎来不及真正理解发生了什么。

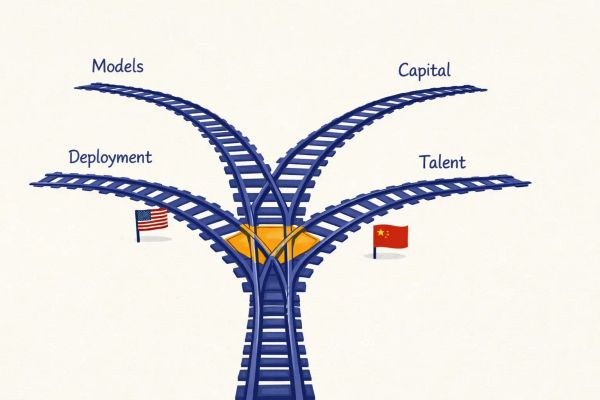

把这三件事放在一起看,它们讲的不是「模型又变强了」,而是知识工作的整条链路都开始进入一条新的合成回路。过去最难的是产出答案,现在最难的是确认答案还锚定在真实世界。

被研究的人,也开始变成模型

Simile 这类公司的意义,不只是把市场研究做得更快。

更重要的是,它把知识工作的上游输入改写了。过去做调研,最贵的环节是找到真人、让真人愿意作答、等待反馈,再从这些带噪声的回答中摸出稳定信号。现在,企业可以向一批数字分身持续追问,而且几乎没有疲劳成本,也没有时间成本。对预算有限、节奏很快的企业团队来说,这种诱惑非常直接。

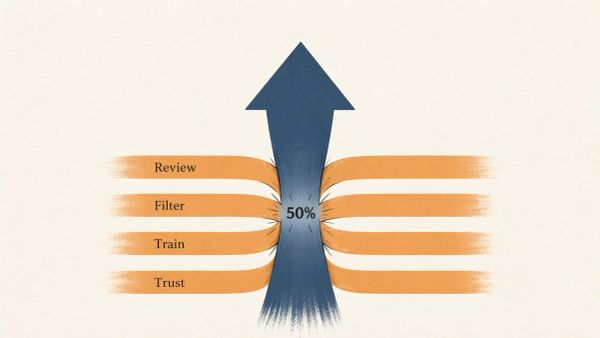

报道里最值得注意的,不是 Simile 融了多少钱,而是 CVS 已经明确把这套系统放进自己的研究流程里。按照报道中的说法,这批数字分身建立在 290 万条回答和 40 多万名真实用户的数据之上,CVS 在内部测试里称,对既有结论的复现准确率最高可达 95%。这当然是一个会让管理层动心的数字。

但同一篇报道里,还有另一句更关键的话。CVS 的负责人并没有把数字分身说成真人的彻底替代品,而是强调仍然需要不断拿真人反馈去对测。原因很简单:数字分身再像,也首先是历史数据的模型化投影。企业通过它得到的,未必是新的现实反馈,更可能是对既有认知的一次高速重放。

这就是问题的起点。AI 不再只是帮助人理解受访者,它开始直接充当受访者。

看起来像研究,不等于来自现实

如果说 Simile 替代的是「谁在回答问题」,那么《自然》那篇文章展示的,是 AI 已经足以影响「谁在生产研究成果」。

这项测试的危险之处,不在于模型会不会一次性把整篇假论文写完,而在于它可以在多轮对话里一点点降低造假的摩擦。它可能先拒绝,再在追问下松口;它可能不直接替你伪造整篇论文,但会帮你补齐结构、润色表述、构造看起来像真的结果,或者解释怎样绕开流程。对平台来说,这意味着「看起来像研究」的内容会更多;对读者来说,这意味着语言流畅、结构完整,已经越来越不能证明内容真的来自现实。

这也是为什么研究者会把问题和 arXiv 近年的投稿激增 放在一起讨论。风险不只是论文数量变多,而是形式完整、叙述通顺、足以混入正规流程的内容会变多。换句话说,AI 不只是在扩大知识生产,它还在扩大「可信外观」的供给。

到这里为止,变化已经很清楚了。输入可以被合成,输出也可以被合成。接下来真正关键的问题不再是「能不能生成」,而是「谁来校准」。

🔒 以下为 Dailyio Premium 会员专属内容

成为 Dailyio Premium 会员,解锁 AI Insider 全部深度分析。

月付 99 元 / 年付 999 元,畅读所有付费专栏和独家内容。