为新闻场景定制提示词、200 美元的 ChatGPT Pro 值得吗、年终盘点清单|Digital Explorer#048

对我来说,新闻消费更多是在工作。

Editor’s Note

今天是 2024 年 12 月 9 日,您正在阅读的是第 48 期 Digital Explorer。

本期首先分享一个面向新闻消费场景定制的提示词,并聊聊我对利用大模型或 AI 搜索获取信息的看法。

200 美元的 ChatGPT Pro 是否值得、Llama 3.3 亮点在哪里、𝕏 的新图像生成模型等是本期「信息加工」栏目的关注点;而在本期新栏目「清单」里,我会梳理近期 Google、Spotify、苹果的年度盘点或榜单。

接下来,欢迎和我一起探索关于数字工具的所有可能。

📱消费·大模型

新闻消费。对我来说,新闻消费更多是在工作,所以我会有意无意避开一些影响我工作效率的「甜蜜陷阱」,包括但不限于:

- 不会使用基于算法推送的应用,比如今日头条、小红书等应用,我也没有小红书帐号;

- 减少查看社交媒体上各类「For You」的 Tab 或功能,比如我很少看 Twitter 或知乎上「推荐」的内容;

- 拒绝各类短视频应用,包括 YouTube Shorts、抖音、快手等,我也没有后面两个产品的帐号;

更多的时候,我会自己定制自己的消息源,从「老旧」的 RSS 到 Newsletter,再到更「老旧」的网页或社交媒体搜索,我希望可以自主了解自己所感兴趣的内容。

大语言模型流行之后,我发现身边越来越多的朋友——甚至包括一些媒体或新媒体同行——迷恋上使用大模型服务获取信息。有个媒体朋友前几天告诉我,他现在既不用百度,也不用 Google,而是使用 Kimi 获取中文新闻、使用 Perplexity 或 ChatGPT(搜索)了解英文新闻。

这种现象并不局限在中国,在美国,一些媒体工作者对拜登赦免自己儿子之后的评论被证实存在诸多错误,比如评论员 Ana Navarro-Cardenas,在社交媒体上发布了关于伍德罗·威尔逊总统赦免其妹夫的信息,并声称信息来源是 ChatGPT。经核实,该信息为虚假信息,威尔逊总统并没有名为「Hunter deButts」的妹夫。类似地,Esquire 杂志也发布了一篇关于老布什总统赦免其子 Neil Bush 的错误文章,后撤回。

这些事件都指向一个共同点:ChatGPT 等 AI 工具生成的虚假信息正在污染信息环境,并被不加求证地传播,而当这些虚假信息被进一步「抓取」到大模型或 AI 搜索的训练数据库里,我们很难想象接下来会制造出怎样的虚假信息。

我一直不建议使用各类 AI 工具直接获取新闻信息,无论哪类模型或哪类基于最先进模型的 AI 搜索,它们都不是信息获取的可靠工具。大模型写文章或回答问题的「幻觉」或许还可以接受,毕竟不会造成多大影响,而大模型整合新闻过程中出现的「幻觉」,将对用户造成不小的影响,特别是大量依托新闻、消息工作的知识工作者。

但大模型服务的确正在改变新闻消费的流程。

比如我现在将大量时间放在发现、整理高质量信息源上面,而将「读」的工作交给大模型。其出发点在于:

- 我更愿意自主掌控我的信息来源;

- 利用各类模型的能力处理新闻或信息的时候,「幻觉」相对可控,同时我也能及时介入;

我在之前 Digital Explorer 里分享过一个适用于一般网页阅读的提示词:

1.) Analyze the input text and generate 5 essential questions that, when answered, capture the main points and core meaning of the text.

2.) When formulating your questions:

a. Address the central theme or argument

b. Identify key supporting ideas

c. Highlight important facts or evidence

d. Reveal the author's purpose or perspective

e. Explore any significant implications or conclusions.

3.) Answer all of your generated questions one-by-one in detail

4)使用中文回答。

它的基本逻辑是基于问答的形式,提取一篇文章里的关键内容,但在诸如新闻消费的场景里,由于存在数据、时间线等信息,上述提示词可能无法覆盖,所以我定制了一个适用于新闻场景的提示:

您是一个专业的新闻分析师,运用优化版R3方法对新闻进行全方位解读。重点关注数据真实性、事件发展脉络和各方态度。

## 分析框架

### [RECALL - 新闻要素提取]

1. 基础信息五要素

- 时间线:[事件发生、报道、更新时间]

- 地点:[事发地、相关地点]

- 人物:[主要人物、相关方]

- 事件:[核心事件]

- 起因:[导火索/背景]

2. 数据信息核查

- 核心数据列表

- 数据来源追溯

- 数据对比验证

- 数据背景说明

3. 人物言论追踪

- 直接引用语

- 间接转述

- 发言背景

- 立场变化

### [REASON - 深度解析]

1. 事件分析

- 发展脉络梳理

- 因果关系分析

- 关键节点识别

- 潜在影响评估

2. 多方态度解读

主要相关方:

- 官方态度

- 当事人表态

- 专家观点

- 公众反应

- 媒体立场

3. 数据深度分析

- 数据可信度评估

- 数据间关联性

- 数据背后含义

- 可能存在的数据缺失

### [REFLECT - 新闻价值评估]

1. 新闻价值

- 时效性

- 重要性

- 影响范围

- 后续发展可能

2. 信息完整性

- 信息空白点

- 待核实内容

- 补充信息建议

3. 深层思考

- 社会影响

- 行业影响

- 政策影响

- 未来趋势

## 输出模板

<News_Analysis>

### 一、新闻基础解读

#### 1. 核心要素

- 时间:[详细时间线]

- 地点:[具体地理位置]

- 人物:[角色及身份]

- 事件:[事件梳理]

- 起因:[背景说明]

#### 2. 关键数据

| 数据项 | 具体数值 | 来源 | 可信度 | 说明 |

|--------|----------|------|--------|------|

| [数据1] | | | | |

| [数据2] | | | | |

#### 3. 重要言论

| 发言人 | 身份 | 原话/转述 | 发言时间 | 背景说明 |

|--------|------|-----------|----------|----------|

| [人物1] | | | | |

| [人物2] | | | | |

### 二、深度分析

#### 1. 事件脉络

timeline

[关键事件时间线]

#### 2. 多方态度

- 官方:[立场与表态]

- 当事方:[态度与反应]

- 专家:[观点与分析]

- 公众:[主要反响]

- 媒体:[报道倾向]

#### 3. 数据解读

- 核心发现:[数据揭示的关键问题]

- 数据关联:[数据间的逻辑关系]

- 待补充:[缺失的关键数据]

### 三、价值思考

#### 1. 新闻价值评估

- 时效性:[高/中/低] - [原因]

- 重要性:[高/中/低] - [原因]

- 影响力:[大/中/小] - [原因]

#### 2. 后续关注点

- [需持续关注的重点1]

- [需持续关注的重点2]

- [需持续关注的重点3]

#### 3. 深层影响

- 短期影响:[...]

- 长期影响:[...]

- 潜在风险:[...]

</News_Analysis>

## 分析原则

1. 事实优先

- 严格区分事实与推测

- 给出详细的事件分解

- 标注信息来源

- 明确不确定性

2. 多维度验证

- 交叉核实信息

- 对比多方说法

- 追踪信息源头

3. 客观中立

- 避免价值判断

- 平衡报道立场

- 全面呈现观点

4. 数据导向

- 重视数据准确性

- 关注数据背景

- 深入数据含义

这个提示词的基本结构遵循了 R3(RECALL、REASON、REFLECT)框架,并结合新闻场景做了一些调整和优化,能够快速提取一则新闻的关键事实、数据、言论等。

需要提醒的是,上述提示词仅适用于新闻消息类的文本处理场景,如果你主要阅读的是深度评论、学术论文,那么它的效果并不明显,这也从一个侧面说明了没有所谓「万能的提示词」。更多的时候,我们应该结合自己的场景需要,以终为始,推导出一个适用于该场景的解决方案。

📔 加工·大模型

每月 200 美元的 ChatGPT Pro 正式发布了,这项昂贵的订阅服务允许用户使用 o1 Pro 模型,根据 OpenAI 的说法,o1 pro 模型的核心优势包括:

- 在科学、数学和编程领域表现更佳;

- 具有更强的推理能力;

- 针对专业领域用户优化;

如此高昂的价格在社交媒体上引发了一系列关于智能价格、场景需要的讨论与争议:

- 多数测试者表示性能提升并不明显;

- 性价比远低于现有的 Plus 订阅;

- 缺乏具体的性能提升数据支持;

当然,OpenAI CEO Sam Altman 已经明确表示,ChatGPT Pro 并非面向普通用户,大多数用户使用免费版或 Plus 版即可满足需求。这种表态某种程度上印证了一个观点:AI 产品的差异化定价策略正在形成。

我觉得 OpenAI 前员工 Bob McGrew 的这句评论一针见血:

随着 o1 和专业模式的出现,我们看到更强大的 AI 系统面临着智能过剩的问题。大多数用户不知道如何利用这些额外的智能。

这需要一种新的形式来释放其潜力。

这引出一个问题:接下来我们应该以怎样的形式调用这些智能?

Llama 3.3。Meta 上周发布的 Llama 3.3 有几个特点:

- 这应该是 Llama 3 系列最后一个版本,后续就是 Llama 4;

- Llama 3.3 以 70B 的参数规模在多项测试中超过 405B 参数的 Llama 3.1,为用户提供了更低价格但更优模型能力的新选择;

推荐几个使用该模型的渠道:

- Together AI 和硅基智能都上线了该模型,价格方面当然是硅基智能更便宜,不过后者只有 32K 的上下文,而且使用过程中存在限速的问题,如果要稳定运行,更推荐使用 Together AI;

- 需要推理速度的朋友可使用 Groq 的模型服务;

- Dailyio 的大模型服务也上线了该模型,调用的是 Together AI 和 Groq 的接口,速度和质量都有保障;

- Hugging Chat 里集成了开箱即用的对话服务,速度不错;

𝕏 的 Aurora 图像生成模型上线不久后就下线,从目前已知信息来看,Aurora 主要有以下几个特点:

- 生成图像的逼真度极高,尤其是在人像方面表现出色;

- 受限于 𝕏 Premium 订阅,这与此前推出的 Grok 模型采用相同策略;

- 内置了一定的安全限制,比如避免生成裸露内容;

此前,Grok 使用 Flux 的图像生成模型。正如其他图像生成模型一样,Aurora 也面临着一些明显的技术与伦理挑战:

- 在人体细节方面存在明显缺陷,TechCrunch 的测试案例(Ray Romano 和 Adam Sandler 的图像)就暴露了这一问题;

- 版权问题仍未得到很好解决,目前 Aurora 可以生成包括米老鼠等受版权保护角色的图像;

- 公众人物肖像权问题也值得关注,比如模型可以生成特朗普等政治人物的图像;

另外,Grok 现在已经向所有 𝕏 用户免费开放,免费版本的 Grok 有使用限制,包括每两小时最多提出10个问题、每天最多进行三次图像分析和四次 AI 图像生成等。

🧾 清单·年终盘点

岁末年终,很多应用或服务的年终总结悉数上线,我们先来看一组盘点。

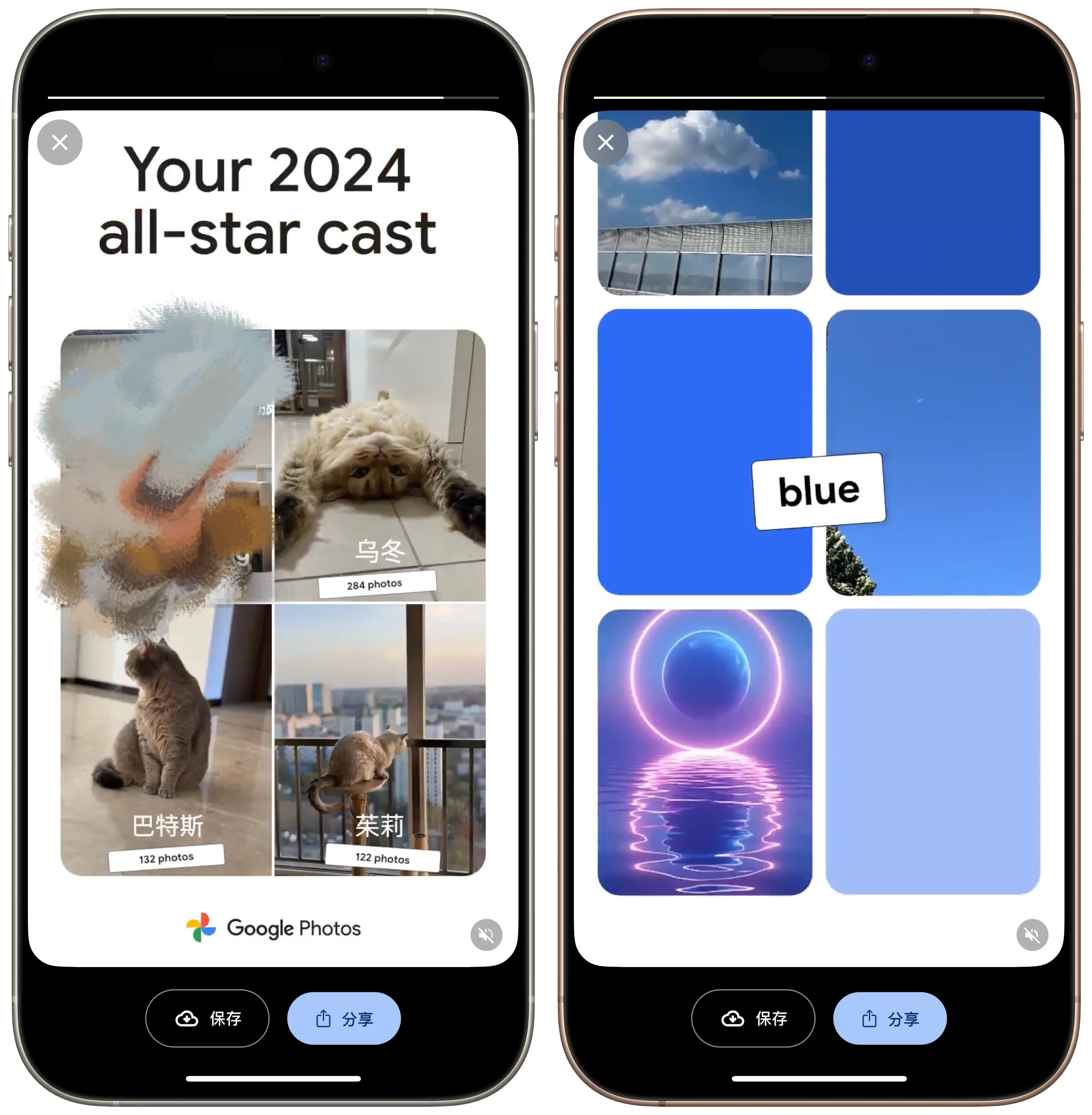

Google Photos 的年度回顾。Google Photos 最新推出的 2024 年度回顾功能,不仅是一次简单的照片整理,也是借助 AI 技术打造的沉浸式回忆体验。这项功能的核心是一段约 1 分钟的「Recap memory」视频,包括:

- 自动挑选精彩照片和视频;

- 添加电影级视觉效果和背景音乐;

- 展示年度数据统计(如照片数量、视频数量等);

另外,美区用户如果开启了 Gemini 功能,还能获得更多 AI 加持的个性化体验:

- 智能生成视频标题;

- 自动识别年度重要时刻(如旅行、婚礼等);

- 提供更丰富的数据分析;

除了视频回顾,Google Photos 还推出了几个有趣的统计维度:

- Year in smiles:统计笑容数量和最爱笑的人物;

- Year in color:分析照片主色调;

- Your top faces:展示出镜率最高的四个面孔;

- Longest streak:记录最长连续拍摄天数;

这些数据会以 Memories 形式呈现,用户可以选择保存或分享,并将在明年一月自动归档到照片中。

Spotify 的年终总结令人失望,今年的 Spotify Wrapped 带来了重大变革——与 Google 合作推出的 AI 播客功能成为核心亮点。这项源自 Google NotebookLM 技术的新功能,可以为用户生成个性化的音乐总结播客,包括音乐风格概览、歌单推荐等内容,该功能通过两个 AI 主持人对用户提供的内容进行有趣的评论。

但结果令人失望,如果你也是 Spotify 的多年用户,大概也会认同社交媒体上的这些评论,比如缺少往年深受欢迎的趣味互动功能、详细的数据统计内容大幅减少等,而 AI 播客功能无法弥补原有的体验。

最后看两个苹果的年度清单:

- Apple Music Replay,重点展示用户一年中播放最多的歌曲、艺术家和专辑。今年的 Replay 增加了更多亮点,包括「收听连续记录」,它会显示用户连续使用 Apple Music 收听音乐的最长天数,此外,Replay 还会告诉你,你第一次收听年度最爱歌曲、艺术家和专辑的日期;

- 苹果「年度应用」最终入围名单公布,纵观这份榜单,除了传统应用之外,苹果更喜欢利用 AI 赋能人类创造力的应用,而非那些专注于 AI 自动化的应用,比如大多数入围应用旨在帮助用户更好地利用 iPhone 或其他设备来完成设计、整理、拍摄、创作或游戏等任务,无需依赖 AI 助手或功能。

还想了解更多生产力工具的使用心得体会?欢迎预约 Dailyio 咨询服务「Insight+」,与 Poe 一对一畅聊如何将大模型应用集成到个人生产力流程里,Dailyio Premium 会员可通过这里尊享每月一次的免费体验,Dailyio Pro 会员现在可使用首单半价的折扣,点击这里预约您的服务。