生成式 AI 的监管难题|AI Insider#186

Plus:阿里云一系列大模型产品的背后还有哪些看点?

Editor’s Note

今天是 2023 年 11 月 1 日,您正在阅读的是第 186 期 AI Insider。

本期首先关注大模型监管领域的新变化,美国政府的行政命令、英国即将举办的 AI 安全峰会等,都会持续影响 AI 产业的发展,但围绕监管的争议也不少,本期提供几个分析角度。

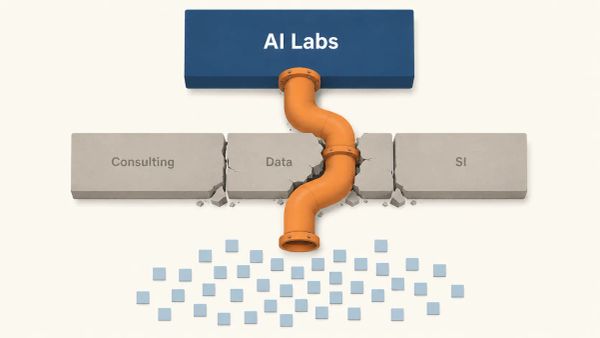

「巨头」部分,阿里云在云栖大会上展示一系列大模型产品,这些发布和布局背后还有哪些看点?AWS 财报前后反映出产业怎样的情绪,本期将给出几个思考方向。

金钱流向层面,OpenAI 以及想成为「下一个 OpenAI」的创业公司还在继续争取巨额融资,以及,2023 年有哪些新晋的 AI「独角兽公司」?

接下来,欢迎和我一起复盘近期围绕智能与数据的产业关键事件。

大模型·监管

全球范围内,政府对大模型监管正在进入一个全新阶段。本周,七国集团和欧盟就 AI 监管原则达成协议,此举也是 2023 年 5 月广岛七国集团峰会 AI 监管议程的延续。

这 11 项原则包括:公司在 AI 系统中识别、评估和减少潜在风险;全力解决 AI 可能被滥用的问题;同时对公司如何保证 AI 系统透明度提出了要求。

需要注意一点,上述原则并不具备强制性,不过考虑到大模型产品在各国落地所面临的法律挑战,主要国家的监管部门的确有能力让上述「自愿性原则」变成「强制政策」。