AI 竞赛,从参数延伸到电厂

算力竞赛还在继续,但真正稀缺的还是电。

Editor's Note

🗓️ 2026.04.13 | Issue#044

OpenAI 上周四给投资者发了一份备忘录,说自己的算力是 Anthropic 的两倍多。同一天,OpenAI 暂停了英国数据中心,原因是电费太高。一边说算力是最大的牌,一边因为付不起电费收缩版图。

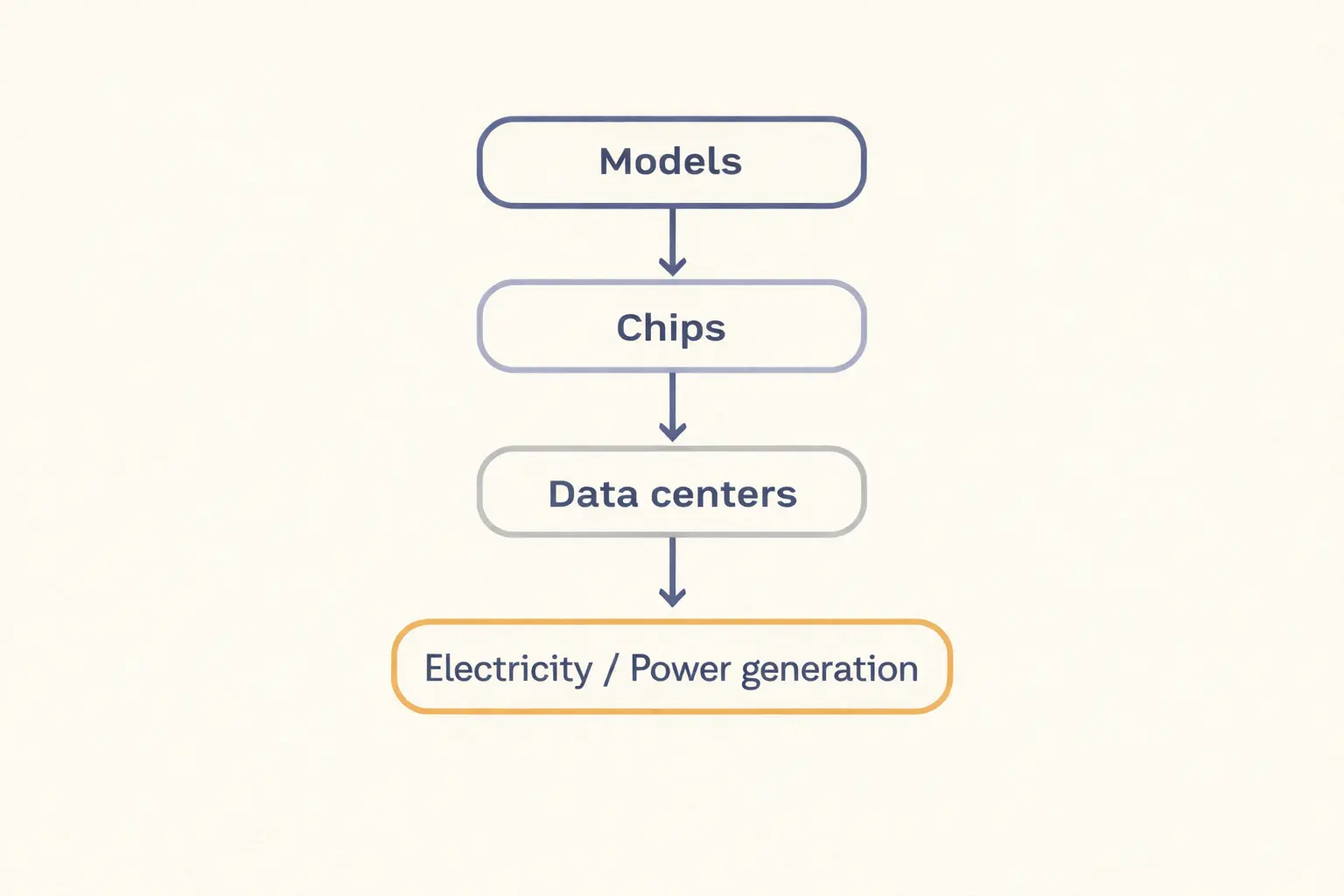

本期 AI Picks 梳理了近期 AI 竞争的新路径——芯片、数据中心和发电厂。Meta 一家签下的算力合同超过 350 亿美元,Anthropic 三天内连下三步棋,连电厂都开始自己建了。把这些碎片拼在一起,试着回答一个问题:当竞争从参数和跑分转向千兆瓦,谁会被甩在后面?

OpenAI 上周向部分投资者发了一份备忘录,Bloomberg 看到了全文。核心数字:OpenAI 2025 年可用算力 1.9GW,是前一年的 3 倍,预计明年进入低两位数 GW 区间,2030 年达到约 30GW。OpenAI 估算 Anthropic 2025 年底只有 1.4GW,明年 7 到 8GW,然后下了一句判断:「这个差距很重要,因为算力现在是产品约束。」

该备忘录发出的时机耐人寻味。几天前 Anthropic 刚把新模型 Mythos 交给苹果、亚马逊等合作方做限定测试。OpenAI 立刻回应,把话题从模型能力拉到算力规模。言下之意:模型好不好是一回事,能不能大规模交付是另一回事。

但 Bloomberg 同一天另一篇报道讲了相反的故事。OpenAI 暂停了去年 9 月宣布的英国 Stargate 项目,原因是英国能源成本在欧洲名列前茅,加上监管不确定性。此前 OpenAI 已关停视频生成应用 Sora,终止了与 Oracle 合作扩建得州旗舰数据中心的计划。上市在即,每一笔支出都要重新算账。算力既是 OpenAI 宣称的最大优势,也是它最大的成本敞口。这个矛盾在同一天暴露。

而 Anthropic 讲的是另一个故事。节奏快得不寻常。

4 月 7 日,Anthropic 宣布与 Google 和 Broadcom 签署新协议,拿下 2027 年起交付的多 GW 级 TPU 算力。这笔合同有多大?CNBC 的报道给出了约 3.5GW 的数字。其实 Broadcom CEO Hock Tan 早在 3 月财报电话上就放过信号:Anthropic 2027 年的需求将「超过 3GW」。Mizuho 的分析师 Vijay Rakesh 团队据此推算,Broadcom 2026 年从 Anthropic 获得的 AI 收入约 210 亿美元,2027 年翻到 420 亿美元。

4 月 8 日,Anthropic 从微软挖来了管过约 1500 人 AI 平台团队、在微软待了 16 年的 Eric Boyd,让他负责基础设施。Boyd 到任后在 LinkedIn 上只写了一句话,提到 Claude Code 最近两个月的爆发让他看到了 AI 真正能做什么。

4 月 10 日,Reuters 报道 Anthropic 正在考虑自研 AI 芯片。计划尚处早期,没有组建专门团队。设计一颗先进 AI 芯片的成本大约 5 亿美元。Meta 和 OpenAI 都已走上同样的路。

不到一周时间,三步棋。签算力、挖人、探索自研。去年底 Anthropic CEO Dario Amodei 在采访中说过一句被广泛引用的话:「有些玩家在 YOLO。」现在 Anthropic 自己的扩张速度不输任何人。年化收入从 2025 年底 90 亿美元跳到 300 亿以上,1000 多个企业客户年支出超 100 万美元,两个月内翻了一倍。Anthropic CFO Krishna Rao 把这叫「纪律性扩张」。OpenAI 的投资者备忘录直接拿这句话开刀:那不是纪律,是当时没想到需求会来得这么快。

两家公司正在拿对方当镜子。Anthropic 说自己克制,OpenAI 就说那是落后。OpenAI 说自己领先,Anthropic 的三天连环动作就是回答。

WSJ 上周拿到了两家公司给投资者看的机密财务文件。最值得看的一组数字是盈亏拆分:如果不算训练下一代模型的算力开支,OpenAI 和 Anthropic 今年的税前运营利润都接近转正(Anthropic 是在最乐观情景下)。也就是说,卖 AI 服务本身已经能赚钱。但一旦把研究算力加回去,OpenAI 要到 2030 年代才能打平,Anthropic 预计自己快一些。训练开支每年翻倍增长,不花就追不上对手,花了就是天文数字的亏损。

不只是这两家在下重注。Meta 上周向 CoreWeave 追加了 210 亿美元算力采购,加上去年 9 月签的 142 亿,合同总额达 352 亿美元。Meta 今年资本支出预算 1150 亿到 1350 亿美元,接近去年的两倍。CoreWeave CEO Mike Intrator 对 CNBC 说得坦率:Meta 完全有能力自己买芯片建机房,但还是选择从 CoreWeave 买,因为交付质量。CoreWeave 自己也在加杠杆,去年底负债 210 亿美元,3 月又借了 85 亿,现在还要再发 30 亿可转债。整条链都在用负债换算力,用算力换合同,用合同再去借更多的钱。

算力竞赛也在搅动芯片层。RISC-V 芯片设计公司 SiFive 上周融资 4 亿美元,英伟达参投,估值 36.5 亿美元,CEO Patrick Little 说这是上市前最后一轮。SiFive 的窗口来自 Arm 上月的转向:Arm 宣布自研芯片,从纯粹的架构授权方变成了客户的潜在对手,原本依赖 Arm 的公司开始认真考虑开源的 RISC-V 方案。同一天,Intel 和 Google 宣布扩大合作,联合开发定制基础设施处理器。Intel CEO Lip-Bu Tan 说了一句容易被忽略但很关键的话:AI 扩展不光靠 GPU 加速器,还需要 CPU 和 IPU 搭起均衡的系统。Intel 还将加入马斯克主导的 Terafab AI 芯片工厂计划。

芯片有了,电从哪来?

Bloomberg 月初的报道已经发出预警。亚太地区预计 2030 年前数据中心投资约 8000 亿美元,但伊朗战争带来的能源冲击正在改变银行的风险判断。新加坡国立大学能源研究所所长 Poh Seng Lee 说得很直接:电力成本正在从运营费用变成贷款审批的核心指标。马来西亚 2 月已经冻结新建非 AI 数据中心。能源冲击不会挡住建设,但会让钱变得更难借。

Meta 的做法更激进。FT 报道,Meta 在俄亥俄州 New Albany 的数据中心项目「Project Walleye」把算力和发电打包进同一笔 30 亿美元贷款。园区自建天然气微电网,不接主电网。这笔贷款的利率定在 SOFR 加 250 个基点,比其他大型科技公司背书的同类项目略高,多出来的溢价对应的就是发电资产的额外风险。一位收到推介的投资人说:「你同时在给两种完全不同的资产做担保。」得州也有类似的案例:Google 为 Anthropic 租用的数据中心提供财务支持,那个园区同样要靠自建的燃气轮机供电。AI 公司开始自己建电厂了。不是因为想建,是因为电网接不上。

竞赛焦点从模型沉到芯片和能源,对中国 AI 产业来说意味着什么?

美国公司争夺的是 GW 级算力集群、3.5GW 的 TPU 合同、自研芯片的可能性。这些选项在出口管制下对中国公司基本不存在。当竞争从「谁的模型跑分更高」转向「谁能签下更多芯片、建更多电厂、借更多钱」,中国公司被卡住的环节就从一个变成了好几个。

但约束也逼出了不同的活法。Rest of World 上周报道了剑桥大学 Frugal AI Hub 的做法:帮发展中国家用极低算力构建 AI 系统。印度南部 Soliga 部落的语音 AI 只用了 5 小时语音数据,跑在不到 50 美元的硬件上。DeepSeek 去年的成功走的也是同一条路:拿不到最多的算力,就用更少的算力做更多的事。难题在于,美国公司正在把竞争从模型层拉到芯片和电厂,把差距锁在物理基础设施上,留给效率路线的时间还有多少?

信号

- Anthropic 布局 PE 生态:WSJ 报道,Anthropic 拟投资 2 亿美元成立合资企业,联合 General Atlantic、黑石等 PE 机构,为投资组合公司提供 Claude 培训和技术支持,总募资目标 10 亿美元。OpenAI 有类似项目「DeployCo」。AI 公司正在把销售做成咨询。

- SoftBank 整合 AI 版图:FT 报道,Arm CEO Rene Haas 将在保留现职的同时统管 SoftBank 国际业务中的半导体、AI 和机器人板块,推进和英伟达竞争的 Project Izanagi 芯片计划。Arm 市值 1580 亿美元,SoftBank 持股约 90%。

- 亚太主权 AI 基建加速:Bloomberg 报道,澳大利亚数据中心建设商 Firmus 融资 5.05 亿美元,Coatue 领投、英伟达参投,估值 55 亿美元。塔斯马尼亚项目将部署 36000 颗英伟达加速芯片,使用可再生能源。6 个月内已累计融资 13.5 亿美元。