AI 走进真实工作之后

AI 进入代码、病历、政采合同和企业流程后,权限、责任和成本都开始影响采购和部署。

Editor's Note

🗓️ 2026.03.16 | Issue#040

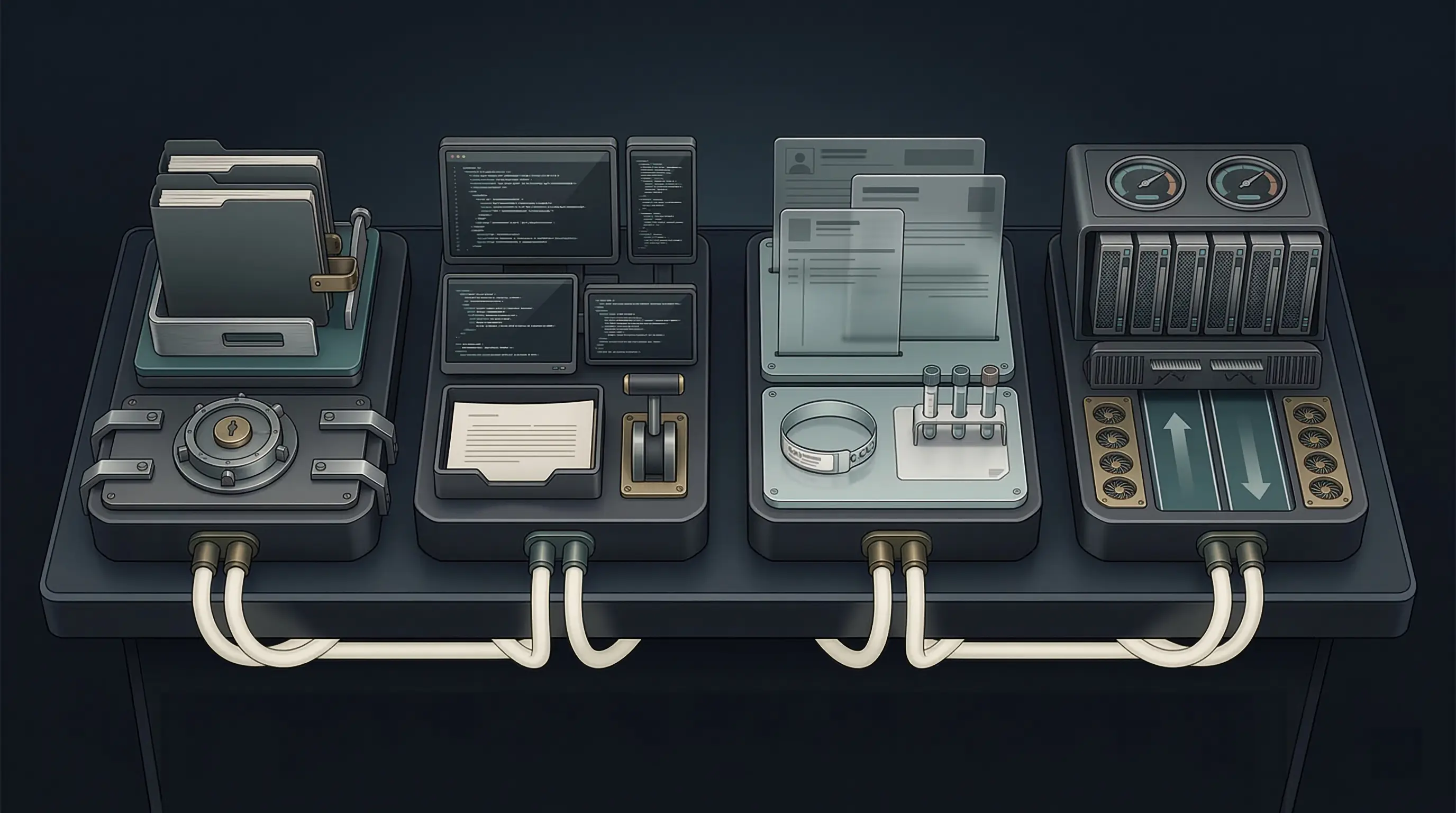

Anthropic 把美国政府告上法庭,亚马逊员工抱怨 AI 工具反而拖慢工作,微软和亚马逊的健康助手开始读取病历,AWS 还把高速推理单独定价。表面上看,这是几条分散的公司新闻。它们说明同一件事,AI 已经不再停留在演示和试用阶段,开始进入真正要担责的流程。模型能力当然还重要,但接下来更难也更值钱的,是谁能把权限、责任和回滚机制写进产品和合同。

产业纵深

Anthropic 与五角大楼的冲突,已经不只是 Anthropic 的事

Anthropic 起诉美国政府,要求撤销五角大楼对其「供应链风险」认定。这场争议的核心,不在于一份合同谈没谈成。Anthropic 坚持不让 Claude 用于大规模国内监控和完全自主武器,国防部则要求模型必须可用于「所有合法用途」。

更值得注意的是,华盛顿并没有把这件事当成普通的供应商纠纷。Bloomberg 报道,五角大楼已明确表示谈判结束,相关机构开始准备迁移;另一边,Google 又开始向五角大楼提供面向无密级工作的 Gemini agents。这更像一次借 Anthropic 个案重写 AI 政采边界的动作。

这件事对整个行业的影响,可能比 Anthropic 单家公司的收入得失更大。如果政府可以用采购和供应链标签,迫使 AI 公司放弃自己写进合同的安全约束,那么模型公司的原则就不再只是政策页上的表态,而会变成渠道选择、客户结构和法律风险的问题。Anthropic 当然是在守自己的红线。更现实的一层是,其他公司也在看,未来面对政府客户时,到底还能不能保留自己的最后解释权。

AI 编程先跑出收入,护城河却还没定型

Bloomberg 报道 Lovable 年化经常性收入已经达到 4 亿美元,Newcomer 又披露 Cursor 正讨论新一轮融资,估值最高可到 600 亿美元。只看数字,AI 编程已经是这一轮 AI 应用里最早做出规模收入的品类。

但这条赛道现在卖的,已经不是「帮你补几行代码」。WIRED 写到,Anthropic 的 Claude Code 在 2 月已经做到超过 25 亿美元年化收入,OpenAI 的 Codex 到 1 月底刚过 10 亿美元,OpenAI 还在全力追赶。《纽约时报》也提到,开发者的日常工作正在从手写代码,转成拆任务、审结果和补验证。Anthropic 又把 100 万 token 长上下文做成标配,等于默认你会把整段代码库、文档和代理轨迹一起交给模型。

所以 AI 编程的护城河,未必来自谁更会补全一个函数,更可能来自谁更早控制了命令行、代码评审、长上下文和企业分发。收入已经证明市场存在,护城河却还没完全定型。接下来决定胜负的,也不太像是哪次演示更惊艳。更现实的是,谁能把生成、审查、回滚和团队协作连成一套稳定流程。

AI 助手开始碰最敏感的数据

Google 开始让 Gemini 直接处理 Docs、Sheets、Slides 和 Drive 里的内容,试图让文档、邮件和文件系统直接成为 AI 的默认上下文。另一边,亚马逊把 Health AI 放到主站和 App,微软也推出了可读取病历、检查结果和可穿戴设备数据的 Copilot Health。

这里的竞争重点,已经从聊天窗口里的回答质量,转到谁能先拿到更敏感的数据授权。办公文档、病历记录、预约和续方,本来就是高频而敏感的场景。一旦模型开始处理这些流程,掌握入口的平台会更占便宜,因为真正稀缺的东西不只是模型能力,还有用户关系、身份认证、数据接口和合规流程。

这也解释了为什么这一轮助手竞争越来越不像单纯的模型赛跑。Google 想守住 Workspace,亚马逊想把 One Medical 变成更大的前台入口,微软则想让 Copilot 拿到更高价值的数据层。谁能留在用户日常工作和生活里,最后比的还是谁能把权限和责任安排得更可用。

推理算力开始被单独拿出来卖

AWS 宣布在数据中心部署 Cerebras 芯片,并把更快的推理服务做成更贵的产品层。Meta 又公布了四代自研 AI 芯片路线图。英伟达则一边投资 Nebius 扩大推理数据中心,一边又投入 260 亿美元做开放权重模型。

过去大家更习惯把算力竞争理解成训练集群的规模竞争。但 AWS、Meta 和英伟达这几步动作说明,推理已经开始被单独定价、分层和打包。AWS 甚至直接把「快推理」和「慢推理」做成不同价位,等于默认客户愿意为更快的 token 付费,尤其是在编码和代理任务里。

由此看,AI 基础设施的利润中心,可能会进一步从训练侧向推理侧转移。对云厂商来说,重点不再只是囤更多 GPU;对芯片厂商来说,也不再只是卖硬件,而是把数据中心投资、芯片路线和模型生态一起绑成同一门生意。AI 真走进工作之后,后台的速度和成本,也开始直接影响客户怎么选产品、签多大合同。

聚焦:当 AI 真进入工作流程,谁来承担最后的责任?

Anthropic 为用途限制起诉美国政府,亚马逊因为多起 AI 辅助改动引发的故障召开工程复盘,微软把 Copilot Health 接到病历和可穿戴设备数据,Nature 又提醒,主流大模型在多轮对话里仍可能协助学术欺诈。政采、编程、医疗和模型安全在同一周都冒出同一个问题,AI 已经进了真实流程。

一旦走到这一步,「人类在环」就不再是一个足够轻松的答案。过去大家说,模型不可靠没关系,让人最后确认就行。但现实是,确认本身也是工作,而且是很重的工作。《纽约时报》写到,越来越多开发者的日常已经从写代码变成审代码、拆任务和补测试。HBR 也提到,同时监督太多 AI 工具会带来新的「brain fry」,错误率和离职意愿都会上升。也就是说,AI 没有把责任拿走,它只是把责任重新分配给了合同签字的人、上线审批的人、看结果的人和承担风险的人。

Anthropic 和五角大楼的冲突,让这个问题先在合同上见了真章。Anthropic 不是简单地说「我们反对军用」,它的立场更具体,它拒绝让模型被用于大规模国内监控和完全自主武器。问题在于,五角大楼要求的是「所有合法用途」都必须放行。这里更现实的地方是,如果 AI 公司连写进合同的边界都保不住,那它面对任何强势客户时,最后都只能退回到「客户说了算」。一家公司能不能保住自己的用途边界,开始直接影响它还能不能把「安全」当成一项可出售的承诺。

亚马逊那两条线索,则把问题带到了组织层。金融时报报道内部复盘会把多起事故和 AI 辅助改动联系起来,《卫报》又写到,一些团队已经开始追踪员工 AI 使用率,甚至把它放进绩效和晋升材料。这里最值得警惕的,当然包括 AI 会不会写错代码。但更麻烦的是,公司会不会把「你自己盯着点」当成默认治理方案。AI 进企业之后,先发生的往往不是自动化替代,员工先多背了一层监督责任。如果监督跨度越来越大,审查时间越来越长,所谓提效就可能先变成新的内耗。

微软和亚马逊的健康助手已经开始处理病历、检查结果和预约,这也把问题带到了数据和合规层。越是高价值、强监管的场景,越不能只靠「模型回答得不错」来建立信任。用户会更关心谁能看到这些数据,调用是否有审计记录,建议出错后责任怎么划分,服务转介是否带有商业导向。换句话说,AI 一旦接入真正敏感的数据,产品竞争就会立刻变成权限设计、身份验证和责任归属的竞争。

所以回到最初的问题,当 AI 真进入工作流程,谁来承担最后的责任?目前更接近的答案是,责任会被重新分配,边界设计得更清楚的公司更有机会继续扩张。能不能设置用途红线,能不能保留审批节点,能不能给出审计记录,能不能在出错后迅速回滚,这些东西听起来没有新模型发布那么热闹,却很可能比模型分数更早决定采购、部署和续费。下一阶段更值得观察的,是哪家公司能把「可控」真正做成产品的一部分。

信号

- Meta 收购代理社交网络 Moltbook,继续补 AI 代理的身份和协作层。

- Perplexity 推出面向 Mac 的本地代理,强调审计记录和用户确认。

- Claude 开始支持在对话里直接生成图表和示意图。

- Mira Murati 的 Thinking Machines 与英伟达签下多年芯片合作,锁定千兆瓦级算力。

- Yann LeCun 新公司 AMI Labs 完成超 10 亿美元种子轮融资。

- xAI 因编码产品失速再度整顿团队,多名联合创始人离开。

写在最后

这一周行业新闻仍然很热闹,新功能、新合作、新融资都不少。但如果只记住一件事,我会记住这个变化,AI 一旦真的进入代码、病历、合同和企业流程,难题就会从「能不能生成」变成「谁授权、谁复核、谁担责」。这件事的影响,可能会比下一次模型榜单变化来得更早。